Teoria informacji/TI Wykład 5

Entropia warunkowa i informacja wzajemna

Definicja [Entropia zmiennej losowej]

Jeśli jest zmienną losową, określamy jej entropię jako

Innymi słowy, jest równe wartości oczekiwanej

gdzie p(X) jest zmienną losową na S zdefiniowaną jako

Umowa notacyjna Jeśli zmienne losowe o których mowa będą wynikały z kontekstu, często będziemy omijać zapis i pisać po prostu a. Przykładowo będziemy pisać p(x|y) zamiast , zamiast itp.

Definicja [Entropia warunkowa]

i ogólnie

- .

Zauważmy że jeśli A i B są niezależne, to w powyższej formule a więc . Z drugiej strony . Ogólnie dla dowolnej funkcji mamy

Rzeczywiście, jeśli to , i w konsekwencji .

Entropia łączna Będziemy również rozważać pary (A,B) jako jedną zmienną losową ,

Prawdopodobieństwo że ta zmienna przyjmie wartość (a,b) wynosi , co zapisujemy w skrócie jako . To prawdopodobieństwo w ogólności jest inne niż . Jeśli dla dowolnych , mówimy że zmienne losowe A i B są niezależne.

Entropia wprost z definicji wynosi

Jeśli A i B są niezależne, to

Z liniowości wartości oczekiwanej dostajemy wtedy

W ogólnym przypadku możemy udowodnić:

Twierdzenie

Dowód

Ważne że powyższe wyrażenie jest dobrze zdefiniowane, bo gdy lub , to również .

Oznaczmy chwilowo

Mamy wtedy

- .

Używając Złotego Lematu dla , dla wszystkich otrzymujemy

Definicja [Informacja]

Komentarz Powyższę definicję łatwo zrozumieć w odniesieniu do Gry w 20 pytań. Przypuścmy że mamy zidentyfikować obiekt który jest parą (a,b) gdzie a i b są wartościami zmiennych losowych A i B. Jeśli A i B są niezależne, najlepsze co możemy zrobić to zidentyfikować niezależnie a i b. Tym samym gramy w dwie niezależne gry „pytania o a” i „pytania o b” (co odpowiada równości ). Jeśli jednak A i B są zależne, możemy wykorzystać tę wzajemną informację do zmniejszenia liczby pytań.

Dla zwiększenia czytelności tekstu, od tej pory będziemy zwykle omijać dolny indeks r, pisząc H, I, itp. Wszędzie tam gdzie nie napisano inaczej, wszystkie twierdzenia odnoszą się do przypadku dowolnego . Bez utraty ogólności czytelnik może założyć r=2.

Komentarz Przekształcając definicję informacji analogicznie jak w ostatnim dowodzie, otrzymujemy:

W takiej postaci widać że informacja jest pewną miarą odległości pomiędzy faktycznym rozkładem zmiennej (A;B), a jej rozkładem gdyby A i B były niezależne.

Warto zauważyć że powyższa suma jest nieujemna, choć niektóre składniki mogą być ujemne.

Istnieje odpowiednik równości , który stosuje się do zmiennych zależnych:

Fakt [Zasada łańcuchowa]

Dowód

Używając zasady łańcuchowej, możemy wyliczać informację na różne sposoby:

Kolejną rzeczą jaką możemy zauważyć to

Łatwo możemy też uogólnić zasadę łańcuchową na przypadek zmiennych

(przyjmujemy konwencję )

Bardziej wyrafinowane uogólnienie możemy uzyskać stosując entropię warunkową:

Fakt [Warunkowa zasada łańcuchowa]

Dowód

W powyższym wyliczeniu sumy po a i b obejmują te wartości, dla których odpowiednie prawdopodobieństwa zależne są zdefiniowane ( nie jest określone jeśli ).

Używamy tu łatwego faktu, że jeśli , to

Uśredniając po p(c) dostajemy:

Czytelnik może teraz łatwo pokazać że:

i równość zachodzi wtedy i tylko wtedy gdy A i B są niezależne w odniesieniu do C, czyli

(dowód na ćwiczeniach TODO)

Definicja [Informacja warunkowa]

Definiujemy informację wzajemną A i B warunkowaną przez C jako

I wreszcie, informację wzajemną A, B i C definiujemy jako:

Łatwo sprawdzimy że ta definicja jest rzeczywiście symetryczna, tzn nie zależy od kolejności A, B i C:

Należy jednak pamiętać że w przeciwieństwie do I(A;B) i I(A;B|C), zdefiniowana powyżej R(A;B;C) może mieć ujemną wartość.

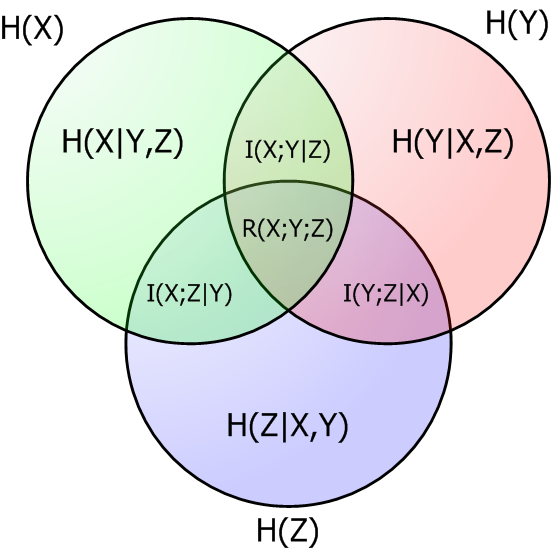

Zależności pomiędzy wartościami H(X), H(Y), H(Z), H(X,Y), H(X,Y|Z), I(X;Y), I(X;Y|Z), R(X;Y;Z) itd. można przedstawić w postaci diagramu: