MN03

Arytmetyka zmiennopozycyjna

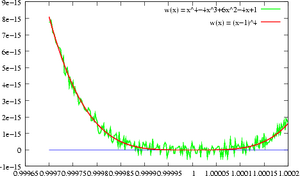

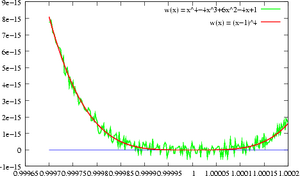

Metody iteracyjne mają czasem kłopoty, które nie są związane z samą naturą problemu matematycznego. Przyrzyjmy się bowiem, jak w dużym zbliżeniu wygląda wykres funkcji , której wartości zostały obliczone na komputerze PC. Nietrudno sprawdzić, że ma dokładnie jedno miejsce zerowe, gdyż . Tymczasem, wykres (wyznaczony oryginalnym wzorem) zdaje się mieć mnóstwo różnych miejsc zerowych w okolicy . Co gorsza, wygląda na to, że wcale nie jest gładka!

Wykonywanie realnych obliczeń na liczbach rzeczywistych w komputerze może być źródłem wielu innych zaskoczeń. Na przykład, w komputerze,

co możesz łatwo sprawdzić:

octave:7> 10 * (1.1 -1) - 1 ans = 8.8818e-16

Przedstawiony wcześniej model obliczeniowy jest modelem idealistycznym, tzn. zakłada on, że wszystkie operacje są wykonywane bezbłędnie. Dlatego w tym przypadku będziemy mówić o arytmetyce idealnej. W praktyce jednak, np. wykonując obliczenia na maszynie cyfrowej, operacje arytmetyczne na liczbach rzeczywistych wykonywane są z pewnym błędem. Matematycznym modelem arytmetyki maszyny cyfrowej jest arytmetyka (albo arytmetyka zmiennoprzecinkowa), którą teraz przedstawimy.

Niech będzie zadana liczba naturalna (jej znaczenie wyjaśni się w następnym rozdziale). Dowolną liczbę rzeczywistą można jednoznacznie przedstawić w postaci

gdzie jest znakiem, liczba całkowita

cechą, a liczba rzeczywista mantysą liczby . Zauważmy, że taki rozkład jest jednoznaczny i odpowiada przesuwaniu przecinka w rozwinięciu binarnym liczby do pierwszej cyfry znaczącej, tj. różnej od zera (stąd nazwa: reprezentacja zmiennoprzecinkowa, ang. floating point). Mantysa ma w ogólności nieskończenie wiele cyfr binarnych w swoim rozwinięciu dwójkowym,

gdzie

. Wobec tego najczęściej nie będzie mogła być zapamiętana dokładnie w pamięci komputera, gdyż możemy przechować jedynie ograniczoną liczbę cyfr cechy i mantysy.

Reprezentacja zmiennoprzecinkowa

W komputerach osobistych mamy do czynienia z reprezentacją liczb rzeczywistych, w której do zapisania liczby używa się ściśle określonej liczby bitów do zapisania mantysy i także określonej liczby bitów do zapisania cechy danej liczby niezerowej :

(łącznie bitów). Liczby zapisane przy użyciu powyższej sekwencji bitów nazywa się liczbami maszynowymi. Są to jedyne dokładnie zapisywalne w komputerze liczby rzeczywiste, pozostałe będą musiały zostać wyrażone z wykorzystaniem liczb maszynowych.

Reprezentacją zmiennoprzecinkową niezerowej liczby będziemy nazywać liczbę taką, że

gdzie jest liczbą dwójkową postaci , natomiast jest liczbą naturalną postaci . Na znak liczby, , przeznaczony jest jeden bit. Wartości i dobiera się tak, żeby była tak bliska jak to możliwe. Stałą całkowitą dobiera się tak, by uzyskać zbalansowany zakres cechy (mniej więcej tyle samo wartości ujemnych i dodatnich), a zysk z korzystania z niej jest taki, że nie marnujemy dodatkowego bitu na przechowywanie znaku wykładnika potęgi dwójki .

Przykład

Rozważmy bardzo prościutki system, w którym zarówno na cechę, jak i mantysę, przeznaczone są jedynie po dwa bity, zatem jedna liczba maszynowa zajmuje 5 bitów. Ponieważ w konsekwencji możliwy zakres wartości to , rozsądne jest więc przyjęcie korekty , dzięki czemu . Z kolei możliwe wartości mantysy to

Wobec tego, jedyne (dodatnie) liczby maszynowe naszej pięciobitowej arytmetyki zmiennopozycyjnej to

{Przy takim sposobie reprezentacji, jej błąd względny szacuje się przez

Liczbę nazywa się precyzją arytmetyki. Jak widać, ma ma ona wpływ na to, jak wiele cyfr znaczących liczby jest reprezentowanych dokładnie. Precyzja arytmetyki zależy wyłącznie od liczby bitów przeznaczonych na reprezentację mantysy.

Ostatnią nierówność wygodnie jest zapisać w równoważny sposób jako

Standard IEEE 754

Z nielicznymi egzotycznymi wyjątkami (np. Cray C90), współczesne procesory używane w komputerach osobistych lub stacjach roboczych implementują [??? IEEE 754 Floating Point Standard], który definiuje dwa zasadnicze formaty reprezentacji zmiennoprzecinkowej liczb rzeczywistych:

| Typ IEEE 754 | Pojedycznej precyzji | Podwójnej precyzji |

| Nazwa typu w C | float | double |

| Liczba bitów cechy | 8 | 11 |

| Liczba bitów mantysy | 23 | 52 |

| Liczba bajtów dla typu w C | 4 | 8 |

| Bias (liczba powyżej) | 127 | 1023 |

| Orientacyjny zakres | ||

| Orientacyjna precyzja | ||

(maksymalna i minimalna wartość cechy ma specjalne znaczenie). Dodatkowo, w

procesorach x86 mamy typ podwójnej rozszerzonej precyzji (także

zdefiniowany w IEEE 754 i odpowiadający dokładnie ówczesnym możliwościom

procesora Intel 8087). Wszystkie operacje arytmetyczne na procesorach x86

są faktycznie wykonywane w takiej precyzji (korzystając z 64 bitów dla

reprezentacji mantysy i 15 bitów dla cechy). Należy pamiętać, że odpowiadający

mu typ w C long double zajmuje w pamięci 12 bajtów (a nie 80 bitów).

Producenci niektórych procesorów świadomie rezygnują z implementacji IEEE 754 dla zwiększenia szybkości działania kosztem niestety dokładności wyniku. Tak dawno temu było w procesorach Cray; tak obecnie działa np. procesor IBM Cell (stosowany w

); tak też działają niektóre instrukcje wektorowe (z tzw.

zestawu 3DNow!) w procesorach AMD, które np. wynik dzielenia wektorowego zwracają z precyzją tylko 14 bitów mantysy.

W Octave można łatwo podejrzeć reprezentację binarną liczby zmiennoprzecinkowej podwójnej precyzji (jest to domyślny typ numeryczny stosowany w MATLABie i Octave),

octave:9> format bit octave:10> x = -2 x = 1100000000000000000000000000000000000000000000000000000000000000 octave:11> x = 1/4 x = 0011111111010000000000000000000000000000000000000000000000000000 octave:12> x = NaN x = 1111111111111000000000000000000000000000000000000000000000000000 octave:13> x = 0 x = 0000000000000000000000000000000000000000000000000000000000000000 octave:14> x = Inf x = 0111111111110000000000000000000000000000000000000000000000000000 octave:15> x = 0.1 x = 0011111110111001100110011001100110011001100110011001100110011010

(w MATLABie możemy zobaczyć tę samą liczbę w zapisie szestnastkowym).

Przykład Nawet liczba 0.1 nie jest reprezentowana dokładnie!

Rozwinięcie dwójkowe liczby 0.1 jest nieskończone:

Ten banalny fakt jest bardzo często przeoczany przez programistów, a w 199x roku doprowadził do spektakularnej awarii systemu antyrakietowego Patriot. Okazało się, że --- w tajemniczy sposób --- zazwyczaj bezbłędnie trafiające w cel rakiety Patriot traciły skuteczność, gdy przez wiele godzin pozostawały w stanie gotowości.

Wyjaśnienie zagadki leżało na styku pomiędzy hardware a software rakiety. Jak zbadano, w celu pomiaru czasu, zliczano kolejne tyknięcia zegara rakiety, które następowały dokładnie co 0.1 sekundy. Następnie, w celu wyznaczenia prawdziwego czasu, mnożono liczbę tyknięć zegara przez 0.1 (które właśnie było niedokładnie reprezentowane). Gdy cykli zegara było bardzo dużo, błąd bezwzględny wyznaczenia czasu stawał się również na tyle poważny, że uniemożliwiał precyzyjne wyznaczenie parametrów toru lotu nieprzyjacielskiego obiektu!

Na marginesie zauważmy, że np. liczba jest reprezentowana dokładnie w arytmetyce zmiennoprzecinkowej (dlaczego?) i nie powodowałaby już tego problemu.

Nie wszystkie maszyny liczące wykorzystują reprezentację dwójkową. Kiedyś zdarzały się komputery reprezentujące liczby w postaci

gdzie lub 16, a nawet 3 (sic!). Do dzisiaj, w podręcznych kalkulatorach najczęściej spotykaną podstawą reprezentacji liczb jest .

Są także takie realizacje arytmetyki zmiennoprzecinkowej, które nie realizują w pełni standardu IEEE (np. stare komputery Cray) i np. zamiast zaokrąglenia, stosują obcięcie wyniku.

Ćwiczenie

Prosty sposób na sprawdzenie, jaka jest podstawa używanej przez nasz komputer arytmetyki (czy dwójkowa, czy dziesiętna):

Nadmiar i niedomiar

W maszynie cyfrowej cecha liczby rzeczywistej nie może oczywiście mieć dowolnie dużej wartości bezwzględnej, , dlatego nie wszystkie liczby rzeczywiste są w ogóle reprezentowalne. Powoduje to powstanie zjawiska nadmiaru gdy dla liczby , oraz zjawiska niedomiaru gdy . W pierwszym przypadku liczba jest tak duża (co do modułu), że nie zawiera się w przedziale liczb reprezentowalnych, a w drugim jest tak mała, że musi być reprentowana przez zero, przy czym błąd względny reprezentacji wynosi wtedy a nie .

Arytmetyka IEEE 754 przyjmuje, że liczby dla których następuje overflow są

reprzentowane przez specjalną wartość Inf (nieskończoność, ze znakiem), która propaguje się w

obliczeniach.

InfW dalszych rozważaniach zjawiska nadmiaru i niedomiaru będziemy dla uproszczenia zaniedbywać, jednak nie zawsze jest to uzasadnione, o czym niech świadczy poniższy przykład.

Przykład Wyznaczanie normy euklidesowej wektora

Jedną z najczęściej wykonywanych operacji na wektorze jest obliczenie jego normy euklidesowej,

Jak widać, możemy tu łatwo zetknąć się ze zjawiskiem zarówno niedomiaru, jak i nadmiaru, gdyż może się na przykład tak złożyć, że mimo iż jest reprezentowana, to już nie (np. w arytmetyce podwójnej precyzji i ).

Łatwym wyjściem z tej sytuacji jest wstępna normalizacja danych tak, by wszystkie nie były większe od 1: niech i wtedy

i teraz suma pod pierwiastkiem jest zawsze pomiędzy 1 a . Wadą omówionego rozwiązania jest to, że wymaga ono dwukrotnego przejrzenia całego wektora (raz, by znaleźć , drugi raz --- by policzyć sumę. Na szczęście można go zmodyfikować tak, by działał w jednym przebiegu. Zupełnie inny algorytm podał Moler .

Liczby denormalizowane

Wymaganie, że mantysa jest postaci , , powoduje, że wokół zera pojawia się coś w rodzaju próżni. Formalnie, liczby mniejsze niż powinny być reprezentowane przez 0, lecz zazwyczaj zamiast tego

octave:16> format bit octave:17> x = 2^(-1022) x = 0000000000010000000000000000000000000000000000000000000000000000 octave:18> x = 2^(-1023) x = 0000000000001000000000000000000000000000000000000000000000000000 octave:19> x = 2^(-1028) x = 0000000000000000010000000000000000000000000000000000000000000000

W ten sposób można (w podwójnej precyzji) zbliżyć się do zera na odległość około .

Działania arytmetyczne w arytmetyce

W arytmetyce implementującej standard IEEE 754, działania arytmetyczne na liczbach rzeczywistych (a raczej na ich reprezentacjach) są wykonywane dokładnie i tylko wynik jest zaokrąglany. Mamy więc

gdzie , Ogólniej, jeśli i są wyrażeniami o wartościach rzeczywistych, to dla dowolnych wartości zmiennych

Zwykle dla prostoty będziemy również zakładać podobną zależność dla niektórych funkcji standardowych, o ile należą one do zbioru operacji elementarnych (chociaż w rzeczywistości są one obliczane przez procedury używające czterech podstawowych operacji arytmetycznych). I tak będziemy mieć np.

gdzie , oraz i są "niewielkimi" stąłymi.

Przykład

Przypuśćmy, że w naszym prościutkim pięciobitowym systemie spełniającym wymogi standardu IEEE 754 zechcemy wykonać mnożenie

Poniżej możemy przekonać się, jak będzie ono przebiegać.

Podobnie, jeśli jest operatorem porównania, , to wartością wyrażenia logicznego w jest dokładna wartość wyrażenia Parser nie mógł rozpoznać (nieznana funkcja „\trianglefl”): {\displaystyle \displaystyle fl_\nu({\cal W}_1)\trianglefl_\nu({\cal W}_2)} .

Dosyć dziwnie w porównaniach zachowuje się specjalna liczba NaN

(ang. not-a-number), dla której zawsze zachodzi, że NaNNaN.

Liczba NaN pojawia się jako wynik zabronionych operacji matematycznych,

np. Inf - Inf, itp., i także propaguje się w

dalszych obliczeniach.

Działania arytmetyczne nie są łączne, co widać na poniższym przykładzie:

octave:9> 7.1 - (7+0.1) ans = 0 octave:10> (7.1 - 7) - 0.1 ans = -3.6082e-16

Ćwiczenie

Wbrew pozorom, fakt, że nie mamy dostępu do arytmetyki nieskończonej precyzji może mieć daleko idące konsekwencje, o czym przekonaliśmy się na początku wykładu.

Praktyczne wyznaczanie precyzji arytmetyki

Aby wyznaczyć precyzję używanej przez nas arytmetyki możemy wykonać prosty test. Pomyślmy, jaka jest najmniejsza dodatnia liczba , która dodana do jedności da w wyniku liczbę większą od 1.0 (liczbę nazywa się czasem epsilonem maszynowym, macheps). Nietrudno sprawdzić, że liczba ta to , gdzie to precyzja arytmetyki:

Jasne jest, że w przypadku arytmetyki IEEE-754 jest to liczba równa podwojonej precyzji arytmetyki, , gdzie jest liczbą cyfr mantysy . Stąd dostajemy prosty algorytm wyznaczania epsilona maszynowego:

x = 1.0;

while ( 1.0 + x > 1.0 )

{

x = x / 2.0;

}

printf("Macheps = }

Jednak, w rzeczywistości musimy być bardziej ostrożni. Implementując ten

algorytm w C następująco (pełna implementacja w pliku macheps.c)

/* Wyznaczanie epsilona maszynowego, wersja 1 */

#include <stdio.h>

int main(void)

{

int dt;

double dx;

dt = 0; dx = 1.0;

while(1.0 + dx > 1.0)

{

dx *= 0.5;

dt++;

}

printf("Macheps (double) = return(0);

}

dostajemy wynik niezgodny z oczekiwaniami:

Macheps = 1.0842e-19. Liczba bitów mantysy = 64.

Wynika to stąd, że w C obliczenia wykonują się zawsze z maksymalną możliwą precyzją. W procesorach x86 jest to precyzja arytmetyki extended double precision, wykorzystującej 80 bitów do reprezentacji liczb. Dlatego działanie

1.0 + dx > 1.0

wykona się w arytmetyce nie podwójnej (64-bitowej), ale rozszerzonej

podwójnej precyzji. Aby sprawić, by działanie zostało wykonane z wykorzystaniem

typu double, musimy nasz program trochę zmodyfikować:

/* Wyznaczanie epsilona maszynowego, wersja 2 */

#include <stdio.h>

int main(void)

{

int dt;

double dx, dxp1;

dt = 0; dx = 1.0; dxp1 = 2.0;

while(dxp1 > 1.0)

{

dx *= 0.5;

dxp1 = 1.0 + dx; /* tym razem wynik działania zostanie zapisany

do zmiennej typu double */

dt++;

}

printf("Macheps (double) = }

Tym razem wynik jest prawidłowy:

Macheps = 2.22045e-16. Liczba bitów mantysy = 53

Ćwiczenie

Sprawdź, jak zmienią się wyniki, gdy wykorzystasz w swoim programie (zarówno w wersji 1, jak w wersji 2) opcje kompilacji:

gcc -O3gcc -ffast-mathgcc -O3 -ffast-math

Spróbuj objaśnić te wyniki, wspomagając się ewentualnie dokumentacją kompilatora.

LAPACK daje gotową funkcję, DLAMCH (dla liczb podwójnej precyzji) i

SLAMCH (dla pojedynczej precyzji), pozwalającą stwierdzić

eksperymentalnie, jakie są parametry używanej arytmetyki, m.in. zakres liczb

reprezentowalnych, w jakim systemie reprezentowana jest mantysa, oraz oczywiście

precyzję arytmetyki i liczbę cyfr mantysy. Polecam analizę kodu źródłowego

LAPACK/dlamch1.f oraz lekturę prac

- Malcolm M. A. (1972) Algorithms to reveal properties of

floating-point arithmetic. Comms. of the ACM, 15, 949-951.

- Gentleman W. M. and Marovich S. B. (1974) More on algorithms

that reveal properties of floating point arithmetic units.

Comms. of the ACM, 17, 276-277.

na których oparto tę funkcję LAPACKa. Poniżej przykład zastosowania tej funkcji

(kod źródłowy: lamch.c) i wyniki uzyskane na procesorze x86.

/* Wyznaczanie epsilona maszynowego i innych charakterystyk arytmetyki podwójnej

precyzji z wykorzystaniem funkcji DLAMCH z LAPACKa */

#include <stdio.h>

#include <math.h>

double dlamch_(char *CMACH); /* funkcja DLAMCH z LAPACKa */

int main(void)

{

char CMACH;

CMACH = 'e';

printf("Epsilon maszynowy: CMACH = 'b';

printf("Podstawa arytmetyki: CMACH = 'n';

printf("Liczba bitów mantysy: CMACH = 'u';

printf("Zakres: CMACH = 'o';

printf("... CMACH = 'r';

if(dlamch_(&CMACH) == 1.0)

printf("Z zaokrąglaniem (dlamch('r') = else

printf("Bez zaokrąglania (dlamch('r') = return(0);

}

Epsilon maszynowy: 2.22045e-16

Podstawa arytmetyki: 2

Liczba bitów mantysy: 53

Zakres: 2.22507e-308 ... 1.79769e+308

Bez zaokrąglania (dlamch('r') = 0)

===Wpływ błędu zaokrągleń na wyniki obliczeń. Redukcja cyfr i inne patologie===

Korzystając z wprowadzonego powyżej modelu arytmetyki zmiennoprzecinkowej możemy spróbować uchwycić wpływ błędu reprezentacji i błędu zaokrągleń na wynik konkretnego algorytmu.

Przykład

Rozważmy banalne zadanie wyznaczenia iloczynu liczb z tablicy ,

W tym celu stosujemy banalny algorytm:

Algorytm

s = 1.0; for (i=0; i < N; i++) s *= x[i];

Sprawdźmy, jak będzie on realizowany w arytmetyce zmiennoprzecinkowej. Dla

uproszczenia założymy, że nie wystąpiło ani zjawisko nadmiaru, ani zjawisko

niedomiaru (w przeciwnym razie dostaniemy w wyniku, odpowiednio, Inf

lub 0).

Naturalnie, zamiast dokładnych wartości , będziemy mieli w komputerze jedynie ich reprezentacje, , przy czym .

Oznaczając wyznaczoną numerycznie wartość iloczynu po -tym kroku pętli, mamy, że

gdzie znów . Ostatecznie więc, wyznaczona wartość iloczynu, spełnia

Ponieważ , gdzie, z pominięciem małych wyższego rzędu, , dostajemy ostatecznie

gdzie . Ponieważ w arytmetyce podwójnej precyzji , to nawet biorąc iloczyn tysiąca (!) liczb, dostajemy wynik, którego błąd względny będzie (o ile tylko nie wystąpi nadmiar/niedomiar) bardzo mały, rzędu !

Powyższe rozumowanie, a także intuicja często wyrażana przez osoby postronne, prowadzi do przypuszczenia, że:

"Duży błąd względny wyniku jest możliwy dopiero po kumulacji błędów zaokrągleń po przeprowadzeniu bardzo wielu działań arytmetycznych."

Jednak to jest to całkowicie fałszywy pogląd, o czym świadczy kolejny, bardzo znamienny przykład.

Przykład Redukcja cyfr przy odejmowaniu

Tym razem nasze zadanie jest znacznie prostsze od poprzedniego. Trzeba wyznaczyć po prostu różnicę dwóch liczb:

Prowadząc analizę jak poprzednio, widzimy, że obliczona numerycznie wartość to

Stąd po prostych oszacowaniach

A więc, gdy , to i w efekcie możemy utracić nawet wszystkie znaczące cyfry wyniku! To zjawisko właśnie nosi żargonową nazwę "utraty cyfr przy odejmowaniu", choć precyzyjnie powinno się mówić o "zmniejszeniu liczby dokładnych cyfr znaczących wyniku przy odejmowaniu dwóch bardzo bliskich sobie liczb".

Przy okazji zauważmy, że prowadząc identyczną analizę dla sumy dwóch liczb , gdzie i są tego samego znaku, dostajemy oszacowanie błędu względnego równe , niezależnie od wartości liczbowych i !

Skutki zjawiska redukcji cyfr przy odejmowaniu mogą być dramatyczne i ujawnić się w nadspodziewanie elementarnych sytuacjach.

Przykład Wyznaczanie pierwiastków trójmianu kwadratowego

Przykład Numeryczna "lupa"

Ten obrazek już widzieliśmy na początku wykładu.

Wyjaśnieniem tej niepokojącej obserwacji jest znowu zjawisko redukcji cyfr przy odejmowaniu: wartości są bliskie zera, a powstają jako suma dużych liczb z przeciwnymi znakami.

Czasem możemy spotkać się z twierdzeniem, że nie warto zawracać sobie głowy metodami numerycznymi, gdyż są dostępne pakiety obliczeń symbolicznych (Maple, Mathematica, MuPAD, Maxima), które potrafią "wszystko policzyć z dowolną precyzją".

To oczywiście też nie jest do końca prawdą. Precyzja, o której mowa, jest jedynie precyzją używanej arytmetyki (rzeczywiście, softwarowo można emulować dowolną precyzję), ale dokładność wyniku nie może być w nich a priori zadana. Wiele bowiem może zależeć od właściwości samego zadania obliczeniowego, o czym mówimy w następnej części wykładu. Na razie prosty przykład:

Przykład Co oznacza precyzja w pakietach symbolicznych

jak wynika z powyższego, w praktyce pakiety symboliczne stosują znacznie większą niż żądana precyzję obliczeń, by ustrzec się najbardziej typowych patologii.

Uwarunkowanie zadania obliczeniowego

Jak zobaczyliśmy w poprzednich przykładach, dane, jakimi dysponujemy wykonując zadanie obliczeniowe są z natury rzeczy wartościami zaburzonymi. Źródłem tych zaburzeń są:

- błąd reprezentacji danych w arytmetyce zmiennoprzecinkowej (0.1 nie jest

równe dokładnie )

- błędy w parametrach będących rezultatem poprzednich obliczeń (chcemy

rozwiązać równanie , ale jest rezultatem innej symulacji), a także

- błędy pomiarowe w zadaniach praktycznych (chcemy policzyć

numeryczną prognozę pogody, ale temperaturę wyjściową znamy tylko z dokładnością do 0.1 stopnia, co gorsza --- z niektórych stacji w ogóle nie mamy danych)

Okazuje się, że powszechna intuicja, że małe zaburzenia danych powinny dawać małe zaburzenia wyniku, nie znajduje potwierdzenia nawet w bardzo prostych przypadkach. Z drugiej strony, umiejętność oceny jakościowego wpływu zaburzenia danych na wynik jest kapitalna w świecie obliczeń numerycznych w ogólności, a w szególności --- inżynierskich.

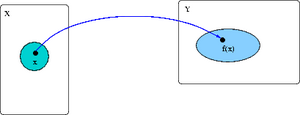

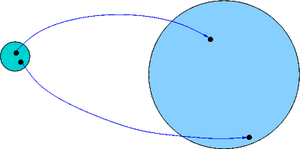

Wprowadza się pojęcie uwarunkowania zadania, to znaczy jego podatności na zaburzenia danych. Dla przejrzystości, przypuśćmy, że nasze zadanie obliczeniowe polega na wyznaczeniu dla danego .

\beginnowiki

\endnowiki

Jak bardzo będzie odległe , gdy ? Rozważa się dwa przypadki:

- uwarunkowanie względne: jak względne zaburzenie danych wpływa na błąd

względny wyniku:

Najmniejszy mnożnik spełniający powyższą nierówność

nazywamy współczynnikiem uwarunkowania (względnego) zadania obliczenia dla danego .

- uwarunkowanie bezwzględne: jak bezwzględne zaburzenie danych wpływa na błąd

bezwzględny wyniku:

Najmniejszy mnożnik spełniający powyższą nierówność

nazywamy współczynnikiem uwarunkowania (bezwzględnego) zadania obliczenia dla danego .

Powiemy, że zadanie jest

- dobrze uwarunkowane w punkcie , gdy ,

- źle uwarunkowane w punkcie , gdy ,

- źle postawione w punkcie , gdy .

Teraz już rozumiemy, że redukcja cyfr przy odejmowaniu jest tylko odzwierciedleniem faktu, że zadanie odejmowania dwóch bliskich liczb jest po prostu zadaniem źle uwarunkowanym!

Przykład Uwarunkowanie zadania obliczenia sumy

Właściwie już wcześniej sprawdziliśmy, że zadanie obliczenia ma

Tak więc, gdy , to i zadanie jest bardzo źle uwarunkowane. Nawet małe zaburzenie względne danych może skutkować bardzo dużym zaburzeniem wyniku. Zgodnie z prawem Murphy'ego, najczęściej rzeczywiście tak będzie...

Przykład

Dla różniczkowalnej funkcji skalarnej mamy

i w konsekwencji dla zadania obliczenia dla danego mamy, przy założeniu małych zaburzeń,

Możnaby myśleć, że złe uwarunkowanie zawsze jest szkodliwe w praktyce numerycznej. Najczęściej właśnie tak jest istotnie. Jednak w praktyce numerycznej sporadycznie zdarza się, że Uzupe�nij: złe uwarunkowanie pewnego podzadania nie tylko nie pogarsza sytuacji, ale wręcz pomaga szybciej rozwiązać zadanie główne!

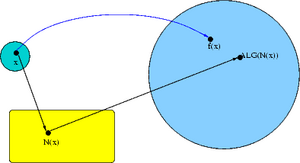

Rozkład algorytmu względem informacji

Algorytm to dokładnie określona i dozwolona w danym modelu obliczeniowym sekwencja akcji, pozwalająca na rozwiązanie danego zadania (w sposób dokładny lub przybliżony).

Z każdym algorytmem związany jest operator

taki że jest wynikiem działania algorytmu w arytmetyce idealnej dla danej .

Zauważmy, że wynik działania algorytmu nie zależy bezpośrednio od , ale raczej od informacji o (uzyskanej dzięki poleceniu ). Informacja ta może być pełna albo tylko częściowa. Informacja jest pełna gdy, np. Parser nie mógł rozpoznać (nieznana funkcja „\inR”): {\displaystyle \displaystyle f=(f_1,\ldots,f_n)\inR^n} i wczytamy wszystkie współrzędne . Informacja może być częściowa, gdy jest funkcją. Wtedy wiele danych może posiadać tę samą informację, co łatwo zaobserwować na przykładzie zadania całkowania.

Niech Parser nie mógł rozpoznać (nieznana funkcja „\inftyR”): {\displaystyle \displaystyle N:F\to\cup_{n=0}^\inftyR^n} będzie operatorem informacji, tzn.

jest informacją o zebraną przy idealnej realizacji algorytmu. Zauważmy, że nformacja jest pełna gdy jest przekształceniem różnowartościowym, tzn. jeśli Parser nie mógł rozpoznać (nieznana funkcja „\nef”): {\displaystyle \displaystyle f_1\nef_2} implikuje Parser nie mógł rozpoznać (nieznana funkcja „\neN”): {\displaystyle \displaystyle N(f_1)\neN(f_2)} . W przeciwnym przypadku mamy do czynienia z informacją częściową.

Każdy algorytm może być przedstawiony jako złożenie operatora informacji i pewnego operatora Parser nie mógł rozpoznać (nieznana funkcja „\toG”): {\displaystyle \displaystyle \varphi:N(F)\toG} zdefiniowanego równością

Zauważmy, że w przypadku informacji częściowej zwykle nie istnieje algorytm dający dokładne rozwiązanie zadania dla każdej danej Parser nie mógł rozpoznać (nieznana funkcja „\inF”): {\displaystyle \displaystyle f\inF} , ponieważ dla danych o tej samej informacji mogą istnieć różne rozwiązania.

Problem wyboru algorytmu

Wybór algorytmu jest najistotniejszą częścią całego procesu numerycznego rozwiązywania zadania. Kierujemy się przy tym przede wszystkim następującymi kryteriami:

- dokładnością algorytmu,

- złożonością algorytmu,

- własnościami numerycznymi algorytmu.

Przez dokładność algorytmu rozumiemy różnicę między rozwiązaniem dokładnym , a rozwiązaniem dawanym przez algorytm w arytmetyce idealnej. Jeśli , Parser nie mógł rozpoznać (nieznana funkcja „\forallf”): {\displaystyle \displaystyle \forallf\inF} , to algorytm nazywamy dokładnym.

Mówiąc o złożoności, mamy na myśli złożoność pamięciową (zwykle jest to liczba stałych i zmiennych używanych przez algorytm), jak również złożoność obliczeniową. Na złożoność obliczeniową algorytmu dla danej składa się koszt uzyskania infomacji (zwykle jest on proporcjonalny do liczby wywołań polecenia ), oraz koszt kombinatoryczny przetworzenia tej informacji, aż do uzyskania wyniku . Koszt kombinatoryczny zwykle mierzymy liczbą operacji arytmetycznych wykonywanych przez algorytm.

Przez własności numeryczne algorytmu rozumiemy jego własności przy realizacji w arytmetyce . Temu ważnemu tematowi poświęcimy teraz osobny paragraf.

Numeryczna poprawność algorytmu

Pożądane jest, aby algorytm dawał "dobry" wynik zarówno w arytmetyce idealnej, jak i w arytmetyce . Niestety, jak zobaczymy, nie zawsze jest to możliwe. Nawet jeśli algorytm jest dokładny to w wyniku jego realizacji w możemy otrzymać wynik daleko odbiegający od . W szczególności, prawie zawsze mamy

Zauważmy również, że o ile z reguły znamy dokładne zachowanie się algorytmu w arytmetyce idealnej dla danej informacji, to nie można tego samego powiedzieć o jego zachowaniu się w arytmetyce . W związku z tym powstaje pytanie, jak kontrolować błąd algorytmów wynikający z błędów zaokrągleń i jakie algorytmy uznamy za te o najwyższej jakości numerycznej.

Istnienie błędów reprezentacji liczb rzeczywistych powoduje, że informacja o danej nie jest w ogólności reprezentowana dokładnie. Znaczy to, że zamiast na informacji dokładnej, dowolny algorytm będzie operować na informacji nieco zaburzonej , tzn. zaburzonej na poziomie błędu reprezentacji. Tak samo wynik dawany przez algorytm będzie w ogólności zaburzony na poziomie błędu reprezentacji. W najlepszym więc wypadku wynikiem działania algorytmu w będzie zamiast . Algorytmy dające tego rodzaju wyniki uznamy za posiadające najlepsze własności numeryczne w arytmetyce i nazwiemy numerycznie poprawnymi.

Dokładniej, powiemy, że ciąg rzeczywisty (a właściwie rodzina ciągów ) jest nieco zaburzonym ciągiem , jeśli istnieje stała taka, że dla wszystkich dostatecznie małych zachodzi

albo ogólniej

gdzie jest pewną normą w . W pierwszym przypadku mówimy o zaburzeniu "po współrzędnych", a w drugim o zaburzeniu w normie .

Zauważmy, że niewielkie zaburzenia po współrzędnych pociągają za sobą niewielkie zaburzenia w normie. Rzeczywiście, jeśli (Uzupelnic: powsp ) to również

i korzystając z faktu, że w przestrzeni skończenie wymiarowej wszystkie normy są równoważne otrzymujemy dla pewnych stałych i

czyli nierówność (Uzupelnic: wnorm ) ze stałą zamiast .

Definicja Algorytm rozwiązywania zadania nazywamy numerycznie poprawnym w zbiorze danych Parser nie mógł rozpoznać (nieznana funkcja „\subsetF”): {\displaystyle \displaystyle F_0\subsetF} , jeśli dla każdej danej Parser nie mógł rozpoznać (nieznana funkcja „\inF”): {\displaystyle \displaystyle f\inF_0} wynik działania algorytmu w arytmetyce można zinterpretować jako nieco zaburzony wynik algorytmu w arytmetyce idealnej dla nieco zaburzonej informacji Parser nie mógł rozpoznać (nieznana funkcja „\inN”): {\displaystyle \displaystyle y_\nu=(N(f))_\nu\inN(F)} o , przy czym poziom zaburzeń nie zależy od .

Formalnie znaczy to, że istnieją stałe , , oraz takie, że spełniony jest następujący warunek. Dla dowolnej oraz informacji Parser nie mógł rozpoznać (nieznana funkcja „\inN”): {\displaystyle \displaystyle y\inN(F_0)} można dobrać Parser nie mógł rozpoznać (nieznana funkcja „\inN”): {\displaystyle \displaystyle y_\nu\inN(F)} oraz takie, że

oraz

Zauważmy,że jeśli Parser nie mógł rozpoznać (nieznana funkcja „\inR”): {\displaystyle \displaystyle f\inR^n} , , oraz algorytm jest dokładny, Parser nie mógł rozpoznać (nieznana funkcja „\equivS”): {\displaystyle \displaystyle {\bf ALG}\equiv\varphi\equivS} , to numeryczną poprawność algorytmu można równoważnie zapisać jako

Rola uwarunkowania zadania

Niech będzie algorytmem numerycznie poprawnym dla danych Parser nie mógł rozpoznać (nieznana funkcja „\subsetF”): {\displaystyle \displaystyle F_0\subsetF} . Wtedy jego błąd w można oszacować następująco:

przy czym . Stąd w szczególności wynika, że jeśli algorytm jest numerycznie poprawny i ciągły ze względu na informację , to

To znaczy, że dla dostatecznie silnej arytmetyki algorytm będzie się zachowywał w prawie tak jak w arytmetyce idealnej.

Z powyższych wzorów wynika, że błąd w algorytmu numerycznie poprawnego zależy w dużym stopniu od:

- dokładności algorytmu w arytmetyce idealnej,

- dokładności arytmetyki ,

- wrażliwości algorytmu na małe względne zaburzenia

informacji .

Ponieważ dwa pierwsze punkty są raczej oczywiste, poświęcimy trochę więcej uwagi jedynie trzeciemu.

Jeśli spełnia warunek Lipschitza ze stałą , a dokładniej

to

W tym przypadku błędy zaokrągleń zwiększają błąd bezwzględny algorytmu proporcjonalnie do .

Bardziej jednak interesuje nas błąd względny. Wybierzmy "małe" i przypuśćmy, że

dla pewnej niezależnej od , tzn. błąd względny informscji, , przenosi się na błąd względny wyniku (w arytmetyce idealnej) ze "współczynnikiem wzmocnienia" , albo na błąd bezwzględny ze współczynnikiem . (Zauważmy, że gdybyśmy wzięli to dla takiej, że musiałoby być , co zwykle, choć nie zawsze, nie jest prawdą.) Wtedy

W szczególności, gdy algorytm jest dokładny i korzysta z pełnej informacji o , tzn. , to błąd

Stąd wynika, że jeśli to błąd względny algorytmu w jest mały, o ile . Błąd względny jest proporcjonalny do dokładności , arytmetyki , współczynników proporcjonalności algorytmu numerycznie poprawnego, oraz do wrażliwości zadania na małe względne zaburzenia danych.

Zwróćmy uwagę na istotny fakt, że interesują nas właściwie tylko te zaburzenia danych (informacji), które powstają przy analizie algorytmu numerycznie poprawnego. I tak, jeśli algorytm jest numerycznie poprawny z pozornymi zaburzeniami danych w normie, to trzeba zbadać wrażliwość zadania ze względu na zaburzenia danych w normie. Jeśli zaś mamy pozorne zaburzenia "po współrzędnych" (co oczywiście implikuje pozorne zaburzenia w normie) to wystarczy zbadać uwarunkowanie zadania ze względu na zaburzenia "po współrzędnych", itd.

Zadania, które nie są zbyt wrażliwe na "małe" względne zaburzenia danych, tzn. dla których jest "niewielkie", nazywamy ogólnie zadaniami dobrze uwarunkowanymi.

Przykład Iloczyn skalarny

Załóżmy. że dla danych ciągów rzeczywistych o ustalonej długości , , , , chcemy obliczyć

Rozpatrzymy algorytm dokładny zdefiniowany powyższym wzorem i korzystający z pełnej informacji o kolejnych współrzednych.

Oznaczmy przez i reprezentacje liczb i w , , , oraz przez i błędy względne powstałe przy kolejnych mnożeniach i dodawaniach. Oczywiście . Otrzymujemy

gdzie w przybliżeniu (tzn. gdy ) mamy i , . Algorytm naturalny jest więc numerycznie poprawny w całym zbiorze danych, gdyż wynik otrzymany w można zinterpretować jako dokładny wynik dla danych i , przy czym .

Zobaczmy teraz, jak błąd we współrzędnych wpływa na błąd wyniku. Mamy

Stąd dla

gdzie

Zauważmy, że jeśli iloczyny są wszystkie dodatnie albo wszystkie ujemne, to , tzn. zadanie jest dobrze uwarunkowane, a błąd względny jest zawsze na poziomie co najwyżej . W tym przypadku algorytm zachowuje się bardzo dobrze, o ile liczba składników nie jest horendalnie duża. W ogólności jednak może być liczbą dowolnie dużą i wtedy nie możemy być pewni uzyskania dobrego wyniku w .

Przykład Pierwiastki trójmianu

Rozpatrzymy teraz zadanie obliczenia wszystkich pierwiastków rzeczywistych równania kwadratowego. Będziemy zakładać, że model obliczeniowy dopuszcza obliczanie pierwiastków kwadratowych z liczb nieujemnych oraz .

Okazuje się, że nie umiemy pokazać numerycznej poprawności "szkolnego" algorytmu obliczającego pierwiastki równania bezpośrednio ze wzorów (Uzupelnic: szkolny ). Można jednak pokazać numeryczną poprawność drobnej jego modyfikacji wykorzystującej wzory Viete'a.

Algorytm

Delta = p*p - q;

if (Delta == 0)

OUT(p);

else

if (Delta > 0)

{

Delta1 = sqrt(d);

if (p >= 0)

{

x1 = p + Delta1;

x2 = q/z1;

}

else

{

x2 = p - Delta1;

x1 = q/ź2;

}

OUT(x1); OUT(x2);

}

Mamy bowiem

gdzie . Wyróżnik obliczony w jest więc nieco zaburzonym wyróżnikiem dokładnym dla danych i . W szczególności

Jeśli to

gdzie . Zauważmy, że ostatnia równość zachodzi dlatego, że dodajemy liczby tego samego znaku. (Inaczej mogłaby być dowolnie duża i tak byłoby w algorytmie szkolnym.) Dla drugiego pierwiastka mamy

gdzie .

Podobny wynik otrzymalibyśmy dla . Algorytm zmodyfikowany jest więc numerycznie poprawny, gdyż otrzymane w pierwiastki są nieco zaburzonymi dokładnymi pierwiatkami dla danych i .

Aby oszacować błąd algorytmu, wystarczy zbadać uwarunkowanie zadania ze względu na zaburzenie danej , ponieważ pokazaliśmy, że zaburzenia można przenieść na zaburzenia i wyniku. Niestety, choć algorytm jest numerycznie poprawny, zaburzenia mogą sprawić, że nawet znak wyróżnika może być obliczony nieprawidłowo. Na przykład dla i mamy , ale . Ogólnie

a więc tylko dla możemy być pewni obliczenia właściwego znaku . Przy tym warunku oraz błąd danych przenosi się w normie euklidesowej na błąd wyniku następująco:

Stąd widać, że zadanie jest dobrze uwarunkowane dla i może być źle uwarunkowane dla . W ostatnim przypadku nie możemy być pewni otrzymania dobrego wyniku w .