MO Moduł 5: Różnice pomiędzy wersjami

Z Studia Informatyczne

Przejdź do nawigacjiPrzejdź do wyszukiwania

Nie podano opisu zmian |

Nie podano opisu zmian |

||

| Linia 36: | Linia 36: | ||

{| border="0" cellpadding="4" width="100%" | {| border="0" cellpadding="4" width="100%" | ||

|width="500px" valign="top"|[[Grafika:MO_M5_Slajd6.png|thumb|500px]] | |width="500px" valign="top"|[[Grafika:MO_M5_Slajd6.png|thumb|500px]] | ||

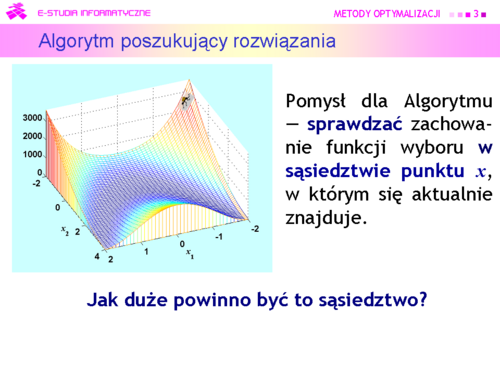

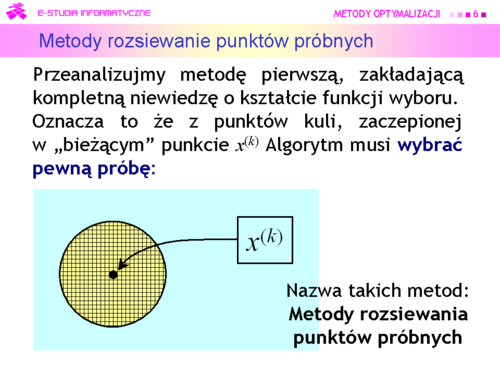

|valign="top"|Przeanalizujmy teraz sposób pierwszy, zakładający kompletną niewiedzę o kształcie funkcji wyboru. Oznacza to że z punktów kuli, zaczepionej w „bieżącym” punkcie | |valign="top"|Przeanalizujmy teraz sposób pierwszy, zakładający kompletną niewiedzę o kształcie funkcji wyboru. Oznacza to że z punktów kuli, zaczepionej w „bieżącym” punkcie x^{(k)} Algorytm musi wybrać pewną próbę, np. tworząc wielowymiarową siatkę i jej węzły uznać za próbę (podejście deterministyczne), czy też wygenerować próbę losowo, bacząc aby była rozłożona równomiernie (podejście probabilistyczne). | ||

|} | |} | ||

---- | ---- | ||

| Linia 43: | Linia 44: | ||

|width="500px" valign="top"|[[Grafika:MO_M5_Slajd7.png|thumb|500px]] | |width="500px" valign="top"|[[Grafika:MO_M5_Slajd7.png|thumb|500px]] | ||

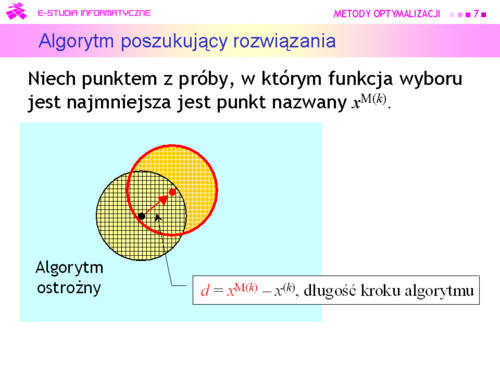

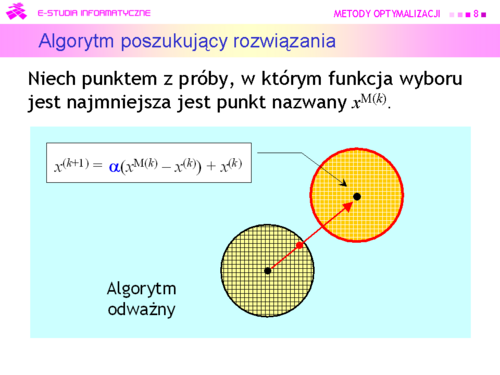

|valign="top"|Algorytm może być: | |valign="top"|Algorytm może być: | ||

* ostrożny (wiem, że schody opadają w prawo, schodzę w prawo jeden stopień)i przyjąć <math>x^{M(k)}<\math> za środek nowego otoczenia | |||

<math>x^{(k+1)}=x^{M(k)}=\alpha (x^{M(k)}-x^(k))+x^{(k)}, \alpha=1</math> | <math>x^{(k+1)}=x^{M(k)}=\alpha (x^{M(k)}-x^{(k)})+x^{(k)}, \alpha=1</math> | ||

a następnie przeszukiwać je tak jak poprzednio. | |||

|} | |} | ||

---- | ---- | ||

Wersja z 13:52, 3 paź 2006

|

|

|

|

|

|

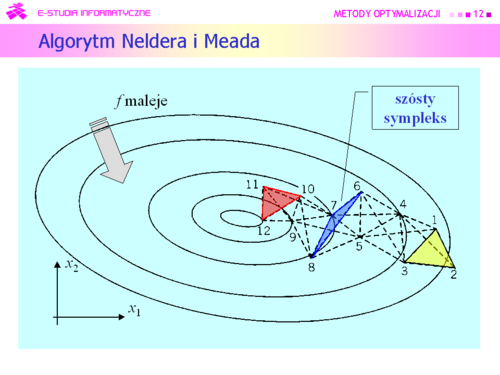

Większość algorytmów deterministycznych poszła w zapomnienie, ale do dzisiaj jest używany algorytm wymyślony przez:

J. A. Neldera i R. Meada i opublikowany w 1965 r. |

|

Dla funkcji kwadratowej algorytm Neldera i Meada zachowuje się bardzo ładnie. |

|

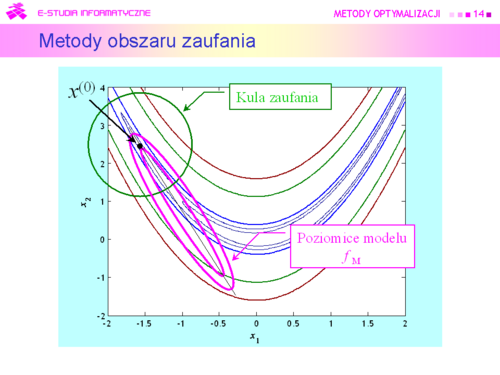

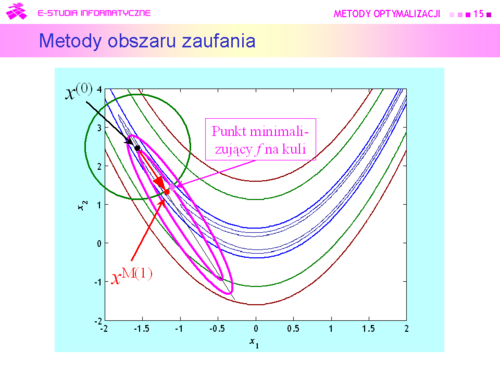

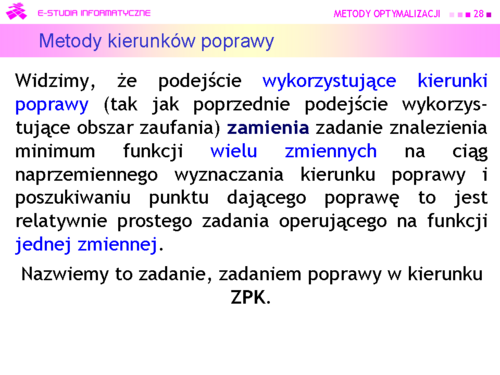

Metody oparte na takim rozumowaniu od połowy lat dziewięćdziesiątych XX w nazywa się:

Metodami obszaru zaufania (Trust region methods) |

|

|

|

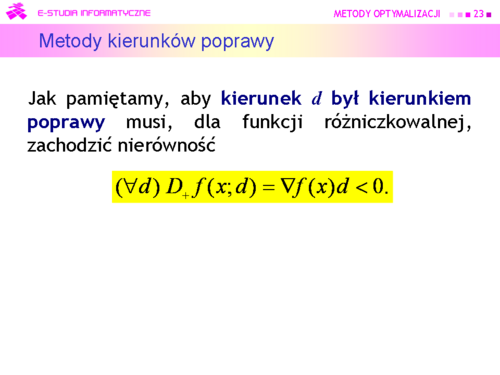

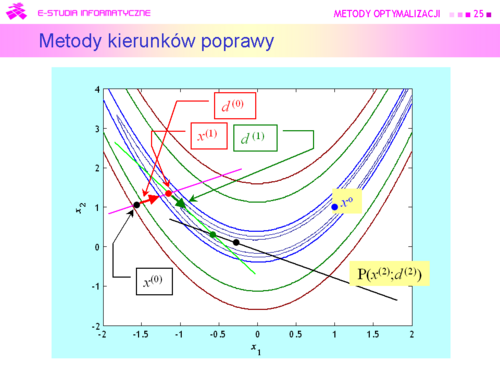

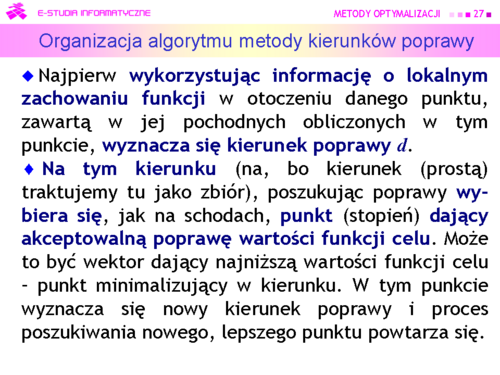

Tu oczywistym pomysłem jest wykorzystanie rozważań teoretycznych, pokazujących związek kierunku poprawy z gradientem (lemat 4.3).

Algorytm będzie zatem wykorzystywał: Metody kierunków poprawy |

|

|

|

|

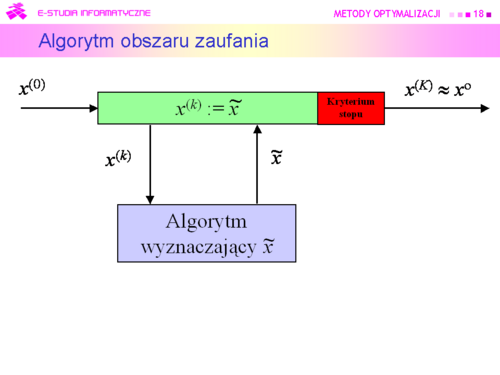

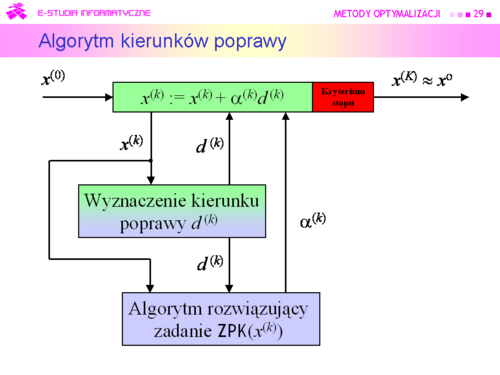

Teraz zauważmy tylko, że test stopu powinien zawierać dwa warunki: jeden badający “optymalność” kolejnego punktu, a drugi określający maksymalną liczbą iteracji. |

|

|

|

|

|

|